DeepX намекает на ИИ-чипы следующего поколения

В Санта-Кларе (Калифорния) в течение Embedded Vision Summit компания DeepX продемонстрировала два чипа первого поколения, которые ориентированы на разные рынки, и сделала несколько намёков относительно своего чипа следующего поколения для «ИИ в устройстве» и для автономных роботов.

Демо

V1, называвшийся ранее L1, является SoC («система на чипе») нейронным процессором от DeepX на 5 TOPs наряду с четырёхъядерными процессорами RISC-V. Он также отличается 12-мегапиксельным процессором обработки изображений (ISP). Это небольшая SoC для периферийных устройств стоимостью менее 10 долларов, созданная на основе 28-нм техпроцесса от Samsung для повышения энергоэффективности. Демонстрационный образец DeepX V1 запускает алгоритм обработки в реальном времени YOLO v7 со скоростью 30fps при энергопакете 1-2 ватта.

Чип DeepX M1, 25-TOPS, 5-Вт, ИИ-ускоритель на карте M.2. (Источник: Салли Уорд-Фокстон/EE Times)

Старший ускоритель M1 разработан для взаимодействия с разделённым хост-процессором. Он оснащён нейропроцессором от DeepX на 25 TOPs с потребляемой мощностью в 5 ватт. Был продемонстрирован M1 в форм-факторе M.2, на котором был запущен алгоритм YOLO v5 с целью позиционирования безопасным в среде коботов (роботов, разделяющих с людьми рабочее пространство). Та же M.2-карта может, например, запустить приложение распознавания лица на промышленном ПК. А также подходит для систем видеонаблюдения, дронов и роботов.

Мультипроцессорная система H1, созданная на основе M1, может запустить алгоритм YOLO v7 более чем в 62 потока на одну карту. Сейчас на карте-прототипе установлено 8 ускорителей M1, но узким местом является хост-процессор, поэтому запускаемая в производство версия будет иметь, вероятно, 4 ускорителя M1 на карте половинного формата, согласно данным компании.

Квантование

Ключевым ингредиентом «секретного соуса» от DeepX станут методы квантования. Компания прислушалась к откликам потенциальных клиентом, которые хотели бы развёртывания на нейропроцессорах DeepX тех алгоритмов, которые пока запускаются на энергоёмких GPU. Требовалось квантование из модели FP32 в INT8, но клиенты не могли принять никакого ухудшения точности по сравнению с версиями, запускаемыми на графических процессорах. Обычно квантование и точность прогнозирования требуют компромисса, и нахождение баланса между ними в развёрнутых системах может «занять столько времени, что проект рискует быть заброшенным», рассказал генеральный директор DeepX Локвон Ким.

DeepX намеревается проанализировать, где именно теряется точность при квантовании, чтобы развивать методы снижения потери точности на этих этапах. Для некоторых моделей это срабатывает настолько хорошо, что квантованная версия INT8 показала лучшую точность предсказания, чем оригинальная FP32.

«Мы думали, что сделали что-то неправильно, и не могли этого понять», — сказал Ким. «Я попросил инженеров разобраться и проверить наши результаты. Они сказали: это не ошибка, это просто умно! Мы применяли это снова и снова, чтобы подтвердить, что это возможно».

Ким, защитивший докторскую степень в области внедрения систем изображений, сказал, что, хотя это и кажется нарушением закона Шеннона, потребовался год, чтобы понять, что происходит на самом деле. Алгоритмы квантования DeepX фактически сокращали переобучение, создавая более способную к обобщениям модель.

«Нам повезло, это не наше изобретение, но наше открытие», — сказал он. «Это было весело! Это был шок, но такое возможно».

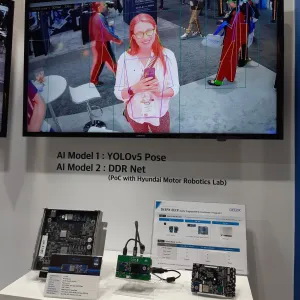

M1 от DeepX работает с YOLO v5 для оценки позы и DDRNet для семантической сегментации. Эта система была создана в качестве доказательства концепции с Hyundai Motor Robotics Lab. (Источник: Салли Уорд-Фокстон/EE Times)

DeepX владеет 60 патентами при 282 поданных заявках, что, по словам Кима, больше, чем у любого другого производителя чипов «ИИ в устройстве». Однако он умалчивает, как именно работают их способы квантования, кроме того, что они включают в себя «четыре или пять» программных и аппаратных методов.

«Это уникальная особенность нашей технологии», — сказал Ким. «DeepX — единственная в мире компания, которая обеспечивает точность ИИ лучшую, чем графические процессоры, и хоть мы используем модель INT8… мы умнее графического процессора».

Стратегия IP

Образцы ускорителя V1 на рынке уже с ноября 2023 года. Ким сообщил, что в настоящее время компания привлекла около 100 клиентов из Европы, Северной Америки и Азии.

Ранее компания сообщила, что собирается лицензировать свои NPU для автопроизводителей. Эта часть бизнеса также развивается, и в первую очередь благодаря европейскими и японскими автопроизводителями, сказал Ким. Производители автомобильного оборудования меняют свой подход. Если раньше производители чипов встречались с заказчиками одного уровня, то теперь OEM-производители запрашивают предложения напрямую, поскольку стремятся конкурировать с Tesla, компанией, производящей собственный чип-ускоритель ИИ.

«Это возможно и с Китаем», — сказал он. «К 2027 году китайские автопроизводители обязаны будут использовать китайские чипы для всех автомобильных приложений, но у них нет продвинутой технологии NPU. Существует высокий спрос [из Китая] на IP NPU».

Главным приоритетом компании остаются продажи чипов, пояснил он.

«Дорожная карта» по чипам

В процессорах следующего поколения DeepX планирует дальнейшую поддержку трансформеров.

«Сегодня мы поддерживаем небольшой ряд трансформеров, и это трансформеры-кодеры [на NPU], но не декодеры», — сказал Ким. «Технически мы можем это сделать, но мы не станем концентрироваться на этом, мы планируем их поддержку в следующем поколении».

Следующее поколение выйдет в конце 2025 года и будет поддерживать «большие языковые модели» (LLM) в конечных устройствах. Модуль М.2 сможет обеспечить 20-30 токенов в секунду, потребляя менее 5 Вт, оценил Ким. Это сделано по просьбам потенциальных клиентов, включая корейского гиганта бытовой электроники LG, с чьей исследовательской группой по ИИ компания DeepX в настоящее время сотрудничает. По словам Кима, LG была бы заинтересована в переносе LLM на чип DeepX в мобильных устройствах, автомобилях и бытовой технике, так как обработка ИИ-запросов в дата-центрах в течение всего срока службы телевизора обойдётся дороже, чем цена самого телевизора.

«[ИИ в устройстве] действительно обретает смысл для их бизнес-моделей с LLM, вот почему мы сотрудничаем», — сказал он. «Они предоставляют свою технологию LLM, чтобы мы могли ознакомится с характеристиками моделей для оптимизации приложений на конкретном устройстве».

Результатом будет NPU-чип, оптимизированный для LLM в устройстве. Первая итерация будет только ускорителем. По словам Кима, потребуется 3-5 лет, чтобы получить SoC с поддержкой LLM, поскольку требуемый объем памяти пока недостижим в конечных устройствах.

«Мы будем придерживаться LPDDR, это важно», — сказал он. «У памяти HBM хорошая пропускная способность, но по стоимости и энергопотреблению она не подходит для мобильных устройств. Вот почему мы фокусируемся на памяти LPDDR, хотя это и трудно реализуемо [для LLM] из-за ограниченной пропускной способности».

Внедрение LLM на кристаллах DeepX является также и значительной программной проблемой, сказал он, отметив, что компания пока не применила методы квантования к LLM.

H1 от DeepX, карта PCIe с 8 чипами M1, запускает и обрабатывает 61 видеопоток одновременно (Источник: Салли Уорд-Фокстон/EE Times)

Между тем, ещё одним чипом в дорожной карте DeepX является V3, редизайн предлагаемого ранее L2, который был переработан в соответствии с рекомендациями китайских и тайваньских клиентов. Он будет обладать двухъядерным нейропроцессором от DeepX производительностью 15 TOPS, а также четырёхъядерным Arm Cortex A52, потребляя в среднем менее 5 Вт. V3 будет оснащён 12-мегапиксельным процессором обработки изображений (ISP), как у V1, а также цифровым сигнальным процессором (DSP) производительностью 75 GFLOPS для поддержки алгоритма SLAM и радарных приложений.

«Ранее мы использовали процессор RISC-V, но клиенты хотели иметь Arm», — сказал он. «Вот почему здесь мы нацелились на четырехъядерный Arm. Также клиенты хотели USB 3.1 и более мощный ISP, а не обновление NPU. Вот почему мы переделали его».

Заказчики хотели Arm-процессор отчасти потому, что экосистема Arm может предложить лучшие решения в области безопасности: многие клиенты выстраивают целые системы камер видеонаблюдения. Другие хотят запускать операционную систему для роботов, которая уже поддерживается на Arm, но ещё не добралась до RISK-V. Пока просто не существует экосистемы для RISC-V, говорит Ким.

Он добавил, что DeepX продолжит предлагать как V1 на базе RISC-V, так и V3 на базе Arm.

Образцы V3 от DeepX станут доступны в конце 2024 года.

Наш каталог современных электронных компонентов: https://components.ru/catalog/